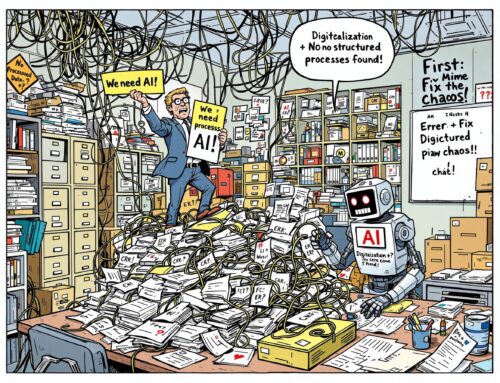

Zwischen Effizienz und Risiko: Wie Unternehmen den sicheren Umgang mit KI im Arbeitsalltag steuern müssen

Künstliche Intelligenz ist in den Büroalltag eingezogen – leise, schnell und oft ungeregelt. Ob im Marketing, in der Projektarbeit oder sogar in der IT: Mitarbeitende nutzen heute ganz selbstverständlich KI-Tools wie ChatGPT, DeepL oder Midjourney, um Texte zu schreiben, Daten auszuwerten oder Ideen zu generieren. Die Vorteile liegen auf der Hand – schneller, effizienter, kreativer.

Doch mit der unkontrollierten Nutzung steigen auch die Risiken: Vertrauliche Informationen werden unbewusst in öffentliche Systeme eingegeben, Daten wandern auf fremde Server, Geschäftsgeheimnisse könnten kompromittiert werden. Hinzu kommt: Vielen Mitarbeitenden fehlt das Risikobewusstsein, Unternehmen selbst haben oft noch keine klaren Regeln oder Schutzmaßnahmen etabliert.

Dieser Artikel beleuchtet, wo die Risiken liegen – aber auch, welche Chancen KI bietet, wenn sie kontrolliert eingesetzt wird. Und vor allem: Was Unternehmen jetzt tun müssen, um Informationssicherheit, Haftung und Innovationskraft in Einklang zu bringen.

KI im Arbeitsalltag – was Mitarbeitende heute schon ganz selbstverständlich nutzen

KI-Tools sind längst Teil des Büroalltags geworden – oft ohne offizielle Freigabe oder Governance. Mitarbeitende lassen sich Mails umformulieren, übersetzen technische Berichte mit DeepL oder erstellen Meeting-Zusammenfassungen mit GPT-Assistenz. In der täglichen Anwendung verschwimmt dabei schnell die Grenze zwischen produktivem Einsatz und Sicherheitsrisiko.

Denn: Viele Tools laufen auf Servern außerhalb des Unternehmens – oft in den USA oder anderen Drittstaaten. Was eingegeben wird, kann theoretisch gespeichert, ausgewertet oder für Trainingszwecke verwendet werden. Wer hier unbedacht arbeitet, öffnet potenziell die Tür zu kritischen Datenverlusten – selbst ohne böse Absicht.

Produktivitätsschub dank KI – welche Chancen Unternehmen jetzt nutzen können

Die Kehrseite der Medaille ist aber auch ihre Stärke: KI kann Prozesse beschleunigen, repetitive Aufgaben automatisieren, Recherchearbeit erleichtern, Sprachbarrieren überwinden und komplexe Datenmengen strukturieren. Unternehmen, die ihren Mitarbeitenden hier gezielte und sichere Lösungen zur Verfügung stellen, schaffen echte Freiräume für wertschöpfende Tätigkeiten.

Gerade in der Wissensarbeit, im Reporting oder bei der Vorbereitung von Entscheidungsgrundlagen liegt enormes Potenzial – sofern der Einsatz bewusst, reguliert und transparent erfolgt.

Unsichtbare Datenlecks – wie Informationen durch KI-Nutzung nach außen wandern können

Das eigentliche Problem ist oft nicht der bewusste Verstoß, sondern der alltägliche Umgang mit KI ohne Sicherheitsverständnis. Texte werden in Chatbots eingegeben, Daten in Analyse-KIs eingespeist oder Screenshots hochgeladen – oft ohne zu wissen, wo die Daten landen oder wie lange sie gespeichert werden.

Viele Mitarbeitende sind sich nicht bewusst, dass KI-Systeme auf große Datenmengen angewiesen sind – und was einmal „gefüttert“ wurde, möglicherweise auch für andere Zwecke weiterlebt.

Kritisch wird es, wenn interne Pläne, personenbezogene Daten oder IP-relevante Informationen so in die Cloud wandern – ein unsichtbares Datenleck, das oft zu spät erkannt wird.

Wenn Unwissen zum Risiko wird – typische Fehleinschätzungen im Umgang mit KI

„Ich habe keine Namen genannt“, „Das ist doch anonymisiert“ oder „Das merkt sich doch nichts“ – solche Aussagen hört man oft im Kollegenkreis. Doch in der Praxis reichen Kontext, Metadaten oder der Dateiname häufig aus, um Rückschlüsse zu ziehen.

Ein typisches Beispiel: Ein Projektleiter lässt sich eine Strategiepräsentation mit einem KI-Tool optimieren – und vergisst, dass sensible Zahlen und Unternehmensziele enthalten sind. Was nach Effizienz aussieht, kann im Zweifel ein Compliance-Verstoß sein.

Die Wurzel liegt meist in fehlender Schulung, unklaren Regeln und mangelnder Transparenz über die Funktionsweise der Tools.

Haftung, Geheimnisschutz & Compliance – das rechtliche Risiko durch unkontrollierte KI-Nutzung

Die Preisgabe von Geschäftsgeheimnissen oder personenbezogenen Daten ist kein Kavaliersdelikt. Laut DSGVO kann bereits die Übertragung in ein nicht EU-konformes System einen meldepflichtigen Vorfall darstellen. Bei besonders schützenswerten Informationen oder Know-how drohen nicht nur Bußgelder, sondern auch zivilrechtliche Haftungsansprüche durch Kunden oder Partner.

Für Geschäftsführungen besonders kritisch: Wer keine klaren Richtlinien oder Schutzmaßnahmen implementiert, riskiert Fahrlässigkeit – und damit die persönliche Haftung. Kommt es zu einem Vorfall, stellt sich schnell die Frage: Hätte das Unternehmen es verhindern können?

Kontrolle statt Verbote – wie Unternehmen die Risiken technisch und organisatorisch in den Griff bekommen

Ein kategorisches Verbot von KI ist selten praktikabel – und auch nicht sinnvoll. Besser ist es, den Einsatz kontrolliert zu ermöglichen: mit klaren Prozessen, zugelassenen Tools und technischen Schutzmaßnahmen. Dazu gehören z. B.:

- Whitelisting von sicheren Tools

- Nutzung interner oder On-Premise-KI-Lösungen

- Monitoring des Datenflusses

- Freigabeprozesse für sensible Anwendungen

- Logging und Auditierung

Ergänzt werden muss dies durch Awareness-Programme und verbindliche Richtlinien, die Mitarbeitenden Orientierung geben.

Governance statt Wildwuchs – warum es klare Spielregeln braucht

Je breiter KI in der Organisation genutzt wird, desto wichtiger wird eine einheitliche Steuerung. Das umfasst:

- klare Zuständigkeiten (z. B. CISO, Datenschutz, IT, Fachbereiche)

- abgestimmte Richtlinien (z. B. für den KI-Einsatz in der Projektarbeit)

- Risikobewertungen und Klassifizierungen von Anwendungsfällen

- Integration in das bestehende ISMS oder Datenschutzmanagement

KI-Governance ist kein separates Projekt – sondern Teil der digitalen Führungsverantwortung.

Dauerhaft sicher – welche Maßnahmen Unternehmen jetzt umsetzen müssen

Ein einmal geschriebenes Regelwerk reicht nicht. Es braucht regelmäßige Updates, wiederkehrende Schulungen, interne Kommunikation und eine Kultur des bewussten Umgangs mit Technologie.

Empfehlenswerte Maßnahmen:

- Interaktive Awareness-Formate (z. B. mit realen Anwendungsfällen)

- Pflichtschulungen beim Einsatz neuer KI-Tools

- Meldepflichten bei unsicherer Nutzung oder Verdachtsfällen

- Einführung von „KI-Nutzungsfreigaben“ bei kritischen Daten

- regelmäßige Audits zum Thema „KI & Informationssicherheit“

Nur so lässt sich eine nachhaltige Sicherheitskultur etablieren – bei gleichzeitiger Nutzung der Chancen.

Fazit: KI richtig steuern – nicht blind vertrauen

Künstliche Intelligenz ist gekommen, um zu bleiben – auch in der Wissensarbeit. Doch mit großer Macht kommt große Verantwortung. Unternehmen müssen jetzt handeln: Richtlinien schaffen, Mitarbeitende befähigen, Risiken bewerten – und die technologische Entwicklung aktiv gestalten.

Denn eines ist klar: Nicht der Einsatz von KI ist das Problem – sondern ihr ungesteuerter Einsatz. Wer heute handelt, schützt nicht nur Daten und Know-how, sondern schafft die Grundlage für vertrauenswürdige und zukunftsfähige Innovation.

Bildnachweis: (C) tungnguyen0905, Pixabay